Для Роскомнадзора разработают систему распознавания лжи по видео

Для подведомственного Роскомнадзору Главного радиочастотного центра (ГРЧЦ) разрабатывают сервис, который позволит проверять видеозаписи выступлений на предмет лжи и манипуляций, пишет «Коммерсантъ». Сервис под названием Expert разрабатывают специалисты Национального центра когнитивных разработок ИТМО, работать он будет на основе искусственного интеллекта (ИИ), рассказали газете источники и подтвердили в ведомстве.

Expert позволяет анализировать видеозаписи на предмет лжи и представляет интерес для оперативного выявления «дипфейков» (deepfake), считает глава Научно-технического центра ГРЧЦ Александр Федотов. По его словам, если ИТМО сможет представить «устойчиво работающую технологию в виде готового продукта», то Роскомнадзор рассмотрит возможность ее применения.

Один из источников газеты сообщил, что прототип сервиса был представлен Роскомнадзору на заседании экспертного совета ГРЧЦ по ИИ в июле и заинтересовал главу Роскомнадзора Андрея Липова. «Он попросил как можно скорее передать его ведомству на тестирование», — рассказал собеседник издания.

Сервис, который разрабатывает научный институт, анализирует видео или аудио, оценивая уверенность, уровень агрессии, конгруэнтность (уровень согласованности информации, передаваемой вербальным и невербальным способами) и противоречивость, а также сравнивает слова с научными статьями и высказываниями других специалистов. При этом в данным момент он заточен на работу с английским языком, который, как пояснил газете руководитель научно-исследовательской лаборатории «Когнитивная невербалика» НЦКР ИТМО Олег Басов, выбран как самый распространенный язык.

Предварительное тестирование система прошла в преддверии выборов в сенат США, ученые анализировали опубликованные на YouTube интервью шести кандидатов «на предмет противоречивости, агрессии и уверенности в себе», рассказал Басов. По его словам, в словах трех кандидатов система обнаружила скрытую агрессию, а одного из них удалось уличить во лжи.

По словам собеседника «Коммерсанта» из числа менеджеров профильной ИT- компании, в данный момент более 90% российских разработок, связанных с ИИ, базируются на скачанных открытых зарубежных библиотеках вместе с дата-сетами для их обучения. Для переобучения подобной системы на русском языке потребуются большой объем данных и значительные затраты, считает собеседник газеты.

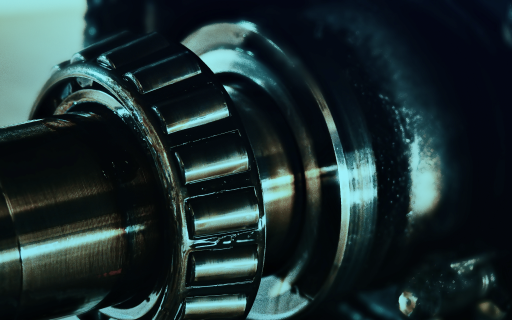

Дипфейки — обработанные видео, которые позволяют создать искусственную реальность. Технология дипфейков заключается в синтезе ИИ человеческих изображений: алгоритм объединяет несколько фото, на которых человек изображен с разным выражением лица, и делает из них видео. При этом ИИ анализирует большое количество снимков и учится тому, как может выглядеть и двигаться конкретный человек

Технологию, которая позволяет создавать такого рода видео, используют в кино, в рекламе, при разработке продуктов с дополненной реальностью и т.п. Используют дипфейки и мошенники.

Так, например, в сентябре 2021 года в социальных сетях распространилось поддельное видео с основателем Тинькофф Банка Олегом Тиньковым, которое было создано с использованием технологии дипфейк. В нем Тиньков якобы обещал подарить 50% к сумме вложений. «Например, вы инвестируете 20 тыс. руб., а на счет для работы получаете 30 тыс. руб.», — говорит поддельный Тиньков. У группы «Тинькофф» есть онлайн-брокер «Тинькофф Инвестиции», который специализируется на инвестиционных услугах для физических лиц. Представитель «Тинькофф» сообщил РБК, что это первый случай, когда мошенники создали дипфейк основателя банка.